硅谷嘲讽,华盛顿嫌弃:为什么他们都在羞辱Anthropic ?

作为一个Anthropic旗下AI模型和工具的铁粉,同时又是Anthropic这家公司和它的创始人Dario Amodei的黑粉,我明白我为什么那么纠结了。

因为我找到了对Anthropic和Dario Amodei最精准的比喻:Anthropic这家公司,以及Dario Amodei这位创始人和CEO,像极了学校里那种最令人讨厌的绩优生。

就是那种好多同学都想打他的“好学生”,老师也不一定待见他。

他成绩优异,尤其是那门最难的课(AI安全)总能拿高分;作业永远工整,甚至主动要求增加extra credit(对AI的强监管政策),凸显自己的优势,打压其他同学。

他平等鄙视和防范任何一位同班的竞争者(OpenAI、xAI和Google等),甚至拒绝在公开场合表现团结(在印度AI峰会上拒绝与Sam Altman拉手);同时对隔壁班的绩优同学(DeepSeek和Kimi等)远程投射绵绵不尽的嫉妒与恶意。

他的同学们私下叫他“告密者”(经常指责其它模型不爱国和不安全),基本什么事儿都不带他玩,跟他的关系都很差,有机会就挤兑他。前任班主任(拜登政府)觉得他还可以用来当遵守严苛纪律的标杆和班级里的眼线,而新班主任(特朗普政府)第一天就烦他:阴郁、啰嗦、敏感、自负、不合群,蔫儿主意又贼多,除了成绩还可以,简直一无是处。

Anthropic与新班主任的冲突很快开始了。

2月16日,Axios报道称五角大楼警告Anthropic将“付出代价”,并威胁将其列为“供应链风险”。这个标签通常是给外国对手的,意味着所有与五角大楼合作的公司都必须证明自己没有使用Claude。

矛盾核心在于:Anthropic不希望Claude被用于开发完全自主武器,而五角大楼要求所有AI模型开放“所有合法用途”,不附加任何条件。

Anthropic是第一家将模型部署在美国军事机密网络的AI公司,跟五角大楼有2亿美元的合同,又不让它的模型用于开发自主武器。这么拧巴的事儿,我是有点没想明白,美防长Pete Hegseth好像也没想明白。

2月23日,Axios报道防长Hegseth将于次日召见Dario Amodei,五角大楼官员对媒体形容这是一场摊牌会面。当日,马斯克旗下的xAI与五角大楼签署协议,接受“所有合法用途”条款,打了Anthropic和Dario Amodei的脸。

在Dario Amodei与美防长会面的当日,Anthropic官方博客突然发起了对它堪比堂吉诃德的风车一般的假想敌——中国大语言模型公司的指控。

Anthropic称DeepSeek、MiniMax和Kimi对Claude实施了“工业规模蒸馏攻击”。并精心列举了数字:24,000个虚假账户,1,600万次对话交互,“系统性提取核心能力”。可能Anthropic自己的人也明白“蒸馏”数据在模型训练过程中再司空见惯不过了,于是以“非法蒸馏可能移除安全护栏,使模型能力被用于军事、情报和监控系统”为由,直指所谓的国家安全问题。

不儿,您真的那么在意美国的国家安全,搁那儿一躺,任五角大楼摆布姿势就齐活了啊。舍近求远,拿中国出来说事儿,证明您爱美国,有用么。委内瑞拉和中国,谁在美国的后花园啊?

反正媒体报道的是:五角大楼与Dario Amodei的会谈不欢而散。五角大楼需要能处理网络战策略的灵活工具,而Dario带去的是一本写满“伦理审查”和“安全对齐”的行为手册。太正确了,以至于无用。

也没有任何美国的两党议员,哪怕是保守派的智库对Anthropic(又又又)对中国发起的指控做出回应,好像它完全不值一提。如果Anthropic跟它一直穷追不舍批判的中国大语言模型一起被列入美国军事供应链的风险名单,那乐子可就大了。

在华盛顿吃了瘪,Anthropic对中国的指控在硅谷也被一边倒的群嘲。

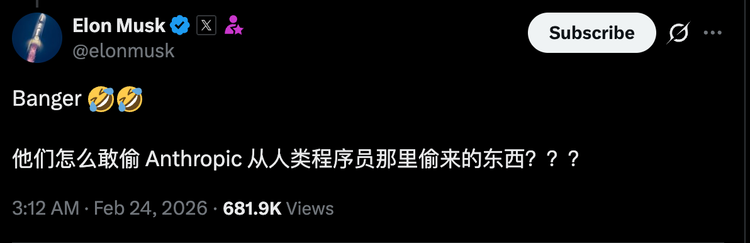

埃隆·马斯克(Elon Musk)在X上的嘲讽最具代表性:“他们怎么敢偷Anthropic从人类程序员那里偷来的东西?”

这句讽刺指向Anthropic去年因非法下载700万本盗版书籍而支付的15亿美元和解金。一个以“AI安全”和“负责任创新”为品牌核心的公司,一边指控他人“偷窃”,一边为自身的版权侵权支付巨额罚金。

AI基础设施公司IO.Net联合创始人Tory Green写道:“你在开放互联网上训练,然后当别人向你学习时,称之为蒸馏攻击。喜欢鼓吹开放研究的实验室,突然为开放访问而哭泣”。

一位X用户制作了广为流传的meme图:“当你做的时候叫蒸馏,当我们做的时候叫训练”(Distillation when you do it.Training when we do it),一语道破Anthropic操弄的“术语政治”双标。

24小时内,从硅谷到华盛顿,从西海岸到东部,Anthropic遭遇了双重羞辱:在华盛顿因为“太道德”被嫌弃,转身就在硅谷因为“不道德”被群嘲。

尽管活该,可它仍然值得被放大观察。

华盛顿的冷脸:新仇旧恨

Pete Hegseth并不是第一个对Anthropic失去耐心的华盛顿要员。从拜登到特朗普,Dario Amodei的“安全布道”正在经历从“被利用”到“被嫌弃”的降级。

拜登时期,白宫需要Anthropic“平衡”彼时正野心勃勃的OpenAI和Sam Altman,同时打压一向跟拜登内阁积怨甚深的马斯克和他的xAI。

更重要的是:Dario Amodei奉为圭臬的RSP(负责任扩展政策)框架、存在性风险叙事,以及对出口管制的激进呼吁,完美契合了民主党政府“预防性管制”的议程。他是AI安全峰会的常客,是国会听证会的明星证人,更是“负责任创新”的代言人。

有Anthropic这么一个活标杆在,硅谷的其它AI“头号玩家”们,好像都不够重视AI风险,都缺乏社会责任心,也都不那么爱美国。

OpenAI和Sam Altman已经被Anthropic和Dario Amodei钉在“不负责任的AI”耻辱柱上很久了,Google在安全议题和AI风险防控上跟拜登内阁也不同频,更别提一直跟拜登政府对着干,而且天天说中国好话的马斯克了。

值得一提的是:2024年2月提出、2024年8月参议院通过、旨在强调管控而非发展,被视为拜登内阁对AI发展基准政策的SB 1047法案,在硅谷受到了压倒性的反对和抵制——无论这些企业家和风险投资大佬是民主党还是共和党的支持者。而Anthropic和Dario Amodei几乎是唯一支持,并力主推动该法案的存在。

这一点,新的白宫主人不会忘记,硅谷的同行们也不会忘记。

2025年1月特朗普政府上台后,游戏规则变了。SB 1047法案很快被废除,被视为阻碍AI创新和发展的绊脚石。新政府要的是“美国赢”的单一叙事,而不是“人类可能输”的警告;要的是能立即部署的AI武器,而不是需要伦理审查的道德导师;要的是灵活的机会主义者,而不是固执的原则守护者。

Dario Amodei没跟上这个转变。据报道,在2月23日与Hegseth的会面中,他试图推销的仍是那套“宪法AI”和“安全对齐”——Claude会拒绝回答敏感问题,会过滤有害请求,会在道德边界前自动刹车,不会支持武器用途(但委内瑞拉打击行动已经用到了Claude,你的安全护栏是不是也太薄弱了?)。

而五角大楼官员的反应是不屑一顾的实用主义:我们需要的是工具,不是意识形态的布道师。

这种“正确性”正成为商业障碍。当与OpenAI的Sam Altman灵活调整立场——从早期“不碰军事”到积极与五角大楼合作,提供“去道德化”的定制版本相比时,Anthropic的“原则性”显得既傲慢又无用。Altman的“无原则机会主义”正是Dario鄙视但有效的策略:在特朗普政府宣布“星际之门”(Stargate)项目时,OpenAI是核心参与者,Anthropic被排除在外。

Dario Amodei随即在达沃斯论坛上奚落该项目是“一团混乱”,但这只会强化他在新政府眼中的“麻烦制造者”形象。作为白宫新主人AI政策对立面的存在,你已经被记在小黑本上了,自己心里真的没数么?

更致命的是Dario Amodei与马斯克旷日持久的公开互相嘲讽,这在华盛顿这个靠关系驱动的城市里是自杀式行为。作为昔日DOGE部门的负责人,马斯克曾一度拥有直接影响AI政策制定的权力,即便是今天他跟特朗普看上去闹掰了,其在AI政策制定上的影响力仍然是Dario Amodei不能比的。据说马斯克曾向特朗普过渡团队建议:不要让Anthropic的人参与任何政府AI项目。这不是商业竞争,而是政治放逐。

而需要真的被放逐的,几乎只有Anthropic。毕竟SB 1047支持者余孽的这个标签,是没法洗脱的。今天的华盛顿对Anthropic和Dario Amodei的不信任是原生的。这个时候,无论在五角大楼表演原则性,还是在官方博客上表演恨中国爱美国,都不太有用。

硅谷的群嘲:咱别装了

如果说华盛顿的嫌弃是冷漠的实用主义,硅谷的嘲讽则是热辣的道德审判。

Anthropic的“蒸馏指控”博客发布时机堪称滑稽——在五角大楼遭遇冷遇和不信任投票的当天。Dario Amodei试图扮演“受害者”博取同情,却被硅谷乃至全美的集体记忆反噬:15亿美元盗版书籍和解金,SB 1047法案的“告密者”前科,以及“只许州官放火”的双重标准。

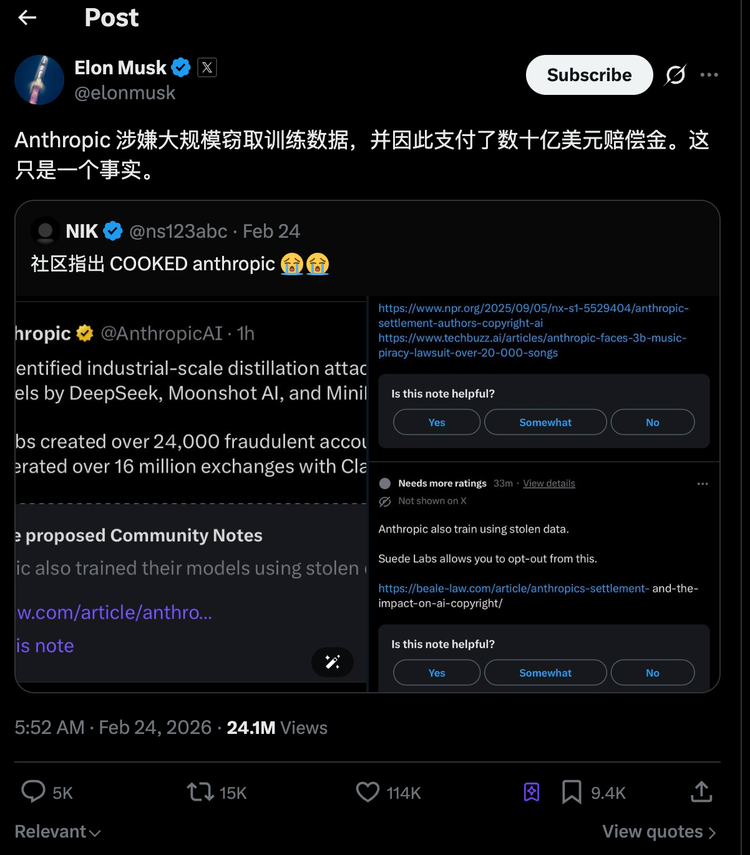

马斯克的开场最具杀伤力。这位xAI创始人在X上写道:“Anthropic自己就是大规模窃取训练资料的罪魁祸首,他们甚至为此支付了数十亿美元的赔偿和解金。这是铁一般的事实”。

他贴出了那张著名的截图:15亿美元版权和解金的记录,配文“MISANTHROPIC”——这个双关语迅速成为X上的热门标签,将Anthropic(人类学)变成了“反人类”(Misanthropic)。

嘲讽不止于马斯克。AI基础设施公司IO.Net联合创始人Tory Green写道:“你在开放互联网上训练,然后当别人向你学习时,称之为‘蒸馏攻击’。喜欢鼓吹‘开放研究’的实验室,突然为开放访问而哭泣。”

另一位X用户的讽刺更直接:“哦不不不,这是我的私有IP,怎么有人敢用它来训练AI模型,只有Anthropic有权使用其他人的IP,不不不,这不能容忍!”

程序员Gergely Orosz的推文代表了开发者的普遍看法:“抱歉,但Anthropic不能两头占便宜。别忘了Anthropic自己是怎么训练Claude的:用版权书籍,只在被起诉后才付钱给版权持有者”。

AI社区群嘲Anthropic的攻击点主要有三个:

一是数字夸张。“工业规模”的24,000账户和1,600万次对话,在中文互联网语境下不过是中等规模的数据采集。一位X用户制作了广为流传的meme图:“当你做的时候叫蒸馏,当我们做的时候叫训练”(Distillation when you do it.Training when we do it),精准戳破了其双标。

二是历史旧账。SB 1047法案期间,Dario Amodei是硅谷大模型公司中唯一公开支持者,这就好比是班级里哪个举报全班“作弊”的叛徒,这是他一贯的形象。可如今他自己也被抓到“抄袭”——Reddit诉Anthropic非法抓取10万条帖子、700万本盗版书籍的15亿和解金。我们小时候,这样的同学是要被约出去墙角先脱裤子再暴打的。

三是逻辑崩塌。将自身使用公开数据美化为”合理”,而将他人贬斥为“非法”——这种定义权的傲慢,在开源文化盛行的硅谷尤为刺耳。ThePrimeagen、Teknium、Suhail等AI圈KOL纷纷加入“虚伪”(hypocrisy)话题的Thread,将这场嘲讽变成了行业共识的展示。

而AI行业的反应比反对更羞辱:集体沉默。没有其他AI公司公开支持Anthropic的指控,甚至通常对华强硬的某些国家安全智库也保持沉默。这不是分歧,而是“不值得认真对待”的宣判——你装啥?谁不知道你怎么想的?谁不知道你正在被华盛顿鄙视,谁不知道你忽然指责中国模型玩家是为了什么?谁不知道你都干过什么?

菜且爱玩

Anthropic在华盛顿和硅谷的两头受气,不是因为它洁白无暇,而是因为它菜且爱玩。

“菜”不是指技术和产品能力,这个Anthropic一点都不菜,反而很优秀;而是指作为一个班级学生,明明不擅长处理除了学习之外的任何社团活动,却还一直用偏执的方法投身进去,结果是人嫌狗不待见。Anthropic这个班上的乖孩子,试图用学生思维(做好作业、遵守规则、获得老师认可)来应对成人世界的权力游戏,结果两头落空。

想玩政治,却不懂规则。支持SB 1047是标志性失误——在班级换届(政府更替)的关键时刻,拿着前任老师的评分标准去举报同学,结果新老师看见他就烦,同学看穿他,都避免跟他同台。

Anthropic想变现道德资本,却发现市场要的是性能,政府要的是工具,舆论要的是一致性——而它的“安全”品牌在三个维度都失败了:Claude的“过度拒绝”损害用户体验,“伦理审查”阻碍国防合同,“指控偷窃”触发黑历史反噬。

更要命的是身份认同的混乱。Anthropic既想当既有AI规则的反抗者,视OpenAI为话语权的最大敌人,又想当规则制定者;既想享受技术精英的地位,又想扮演道德权威的教师爷;既想参与权力游戏,又不愿接受游戏的肮脏。

这种“令人尴尬的虚伪”——把商业竞争包装成道德警察,把政治投机包装成安全担忧,把自我利益包装成公共利益——这是Anthropic哪怕产品和工具再好用,而始终在公共空间和舆论场不招人喜欢的终极原因。不是因为它坏,而是因为所有人都看穿了那套“我比你更道德”的尬到抠出脚趾的表演,而表演者自己似乎还没意识到,观众们已经快吐了。

这个绩优生,拿着过时的规则手册,在班级里试图同时讨好新老师和欺负其他同学。老师(特朗普政府)需要能打仗的工具,不需要道德作业;同学(硅谷)记得他举报作弊的前科,也看穿他抄袭的事实。当他站在操场中央大声指控“有人偷我的作业”时,回应他的只有远处的嘲笑。